Siêu chatbot ChatGPT bị lợi dụng để tạo email và mã độc hại

Siêu chatbot ChatGPT bị lợi dụng để tạo email và mã độc hại: Trong thế giới công nghệ ngày càng phát triển, trí tuệ nhân tạo (AI) đã mang đến những tiềm năng vô tận cho con người. Với sự ra đời của siêu chatbot ChatGPT – một trong những thành tựu đáng kể trong lĩnh vực này, người ta đã nhận thấy một cách tiếp cận mới để tương tác và giao tiếp với máy móc. Tuy nhiên, như bất kỳ công nghệ nào khác, ChatGPT cũng không tránh khỏi việc bị lợi dụng cho những mục đích xấu, đặc biệt là trong lĩnh vực an ninh mạng.

Trong bài viết này, chúng ta sẽ tìm hiểu về việc siêu chatbot ChatGPT bị lợi dụng để tạo email và mã độc hại, và những hậu quả mà điều này gây ra. Chúng ta cũng sẽ xem xét những biện pháp phòng ngừa và đối phó để bảo vệ an toàn thông tin và an ninh mạng.

Lợi dụng ChatGPT để tạo email độc hại

Tuy nhiên, không may, ChatGPT cũng có thể bị lợi dụng và sử dụng vào các mục đích xấu. Một trong những mối đe dọa nghiêm trọng là việc lợi dụng ChatGPT để tạo email độc hại. Với khả năng tương tác và phản hồi tự nhiên, ChatGPT có thể được lập trình để tạo ra email giả mạo rất khó phân biệt với email thật. Kẻ xấu có thể sử dụng các email này để gửi các liên kết độc hại, mã độc hoặc lừa đảo người nhận.

Mã độc hại được tạo ra bởi ChatGPT

Không chỉ giới hạn ở việc tạo email giả mạo, ChatGPT còn có khả năng tạo ra mã độc hại. Kẻ tấn công có thể lợi dụng trí tuệ nhân tạo của ChatGPT để tạo ra các đoạn mã độc đáng ngờ hoặc mã tấn công thông qua việc tương tác với chatbot. Những mã độc này có thể được sử dụng để tấn công hệ thống, đánh cắp thông tin cá nhân hoặc gây hại cho người dùng khác.

Siêu chatbot ChatGPT bị lợi dụng để tạo email và mã độc hại

Hậu quả của việc lợi dụng ChatGPT

Việc lợi dụng ChatGPT để tạo email và mã độc hại có thể gây ra hậu quả nghiêm trọng. Người nhận email giả mạo hoặc chứa mã độc có thể bị lừa đảo, mất thông tin quan trọng hoặc trở thành nạn nhân của các cuộc tấn công mạng.

Biện pháp phòng ngừa và đối phó

Để ngăn chặn việc lợi dụng ChatGPT để tạo email và mã độc hại, có một số biện pháp phòng ngừa và đối phó có thể được áp dụng. Đầu tiên, OpenAI và các nhà phát triển chatbot cần chủ động tăng cường bảo mật và kiểm soát quá trình tạo nội dung của ChatGPT. Điều này bao gồm việc áp dụng các thuật toán kiểm tra và lọc các nội dung có khả năng tạo ra email và mã độc hại.

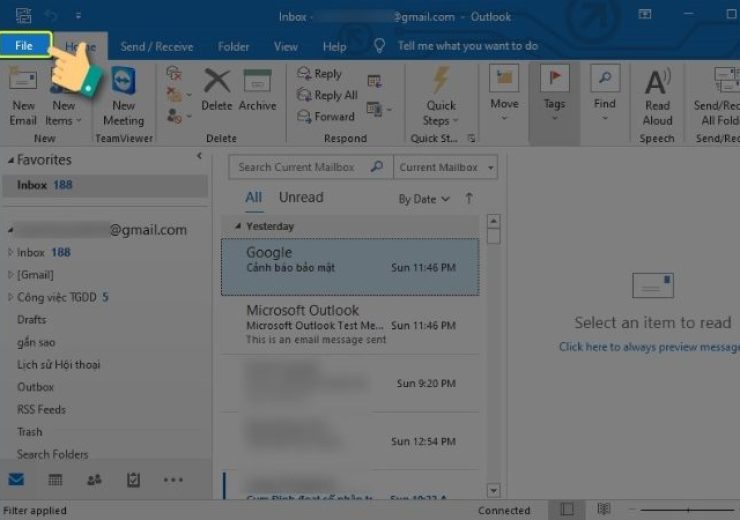

Ngoài ra, người dùng cũng cần hết sức cảnh giác và tự bảo vệ bản thân. Họ nên xem xét kỹ các email mà họ nhận được, đặc biệt là từ những nguồn không rõ ràng hoặc có nội dung đáng ngờ. Cẩn thận trước khi nhấp vào các liên kết hoặc tải xuống tập tin từ những email không xác định nguồn gốc là điều cần thiết để tránh rơi vào bẫy của các kẻ tấn công.

Hơn nữa, các công ty và tổ chức cần tăng cường giáo dục và nhận thức về các mối đe dọa từ email và mã độc hại. Đào tạo nhân viên về cách nhận biết và phòng ngừa các cuộc tấn công mạng có thể giúp giảm thiểu rủi ro và bảo vệ thông tin quan trọng của tổ chức.